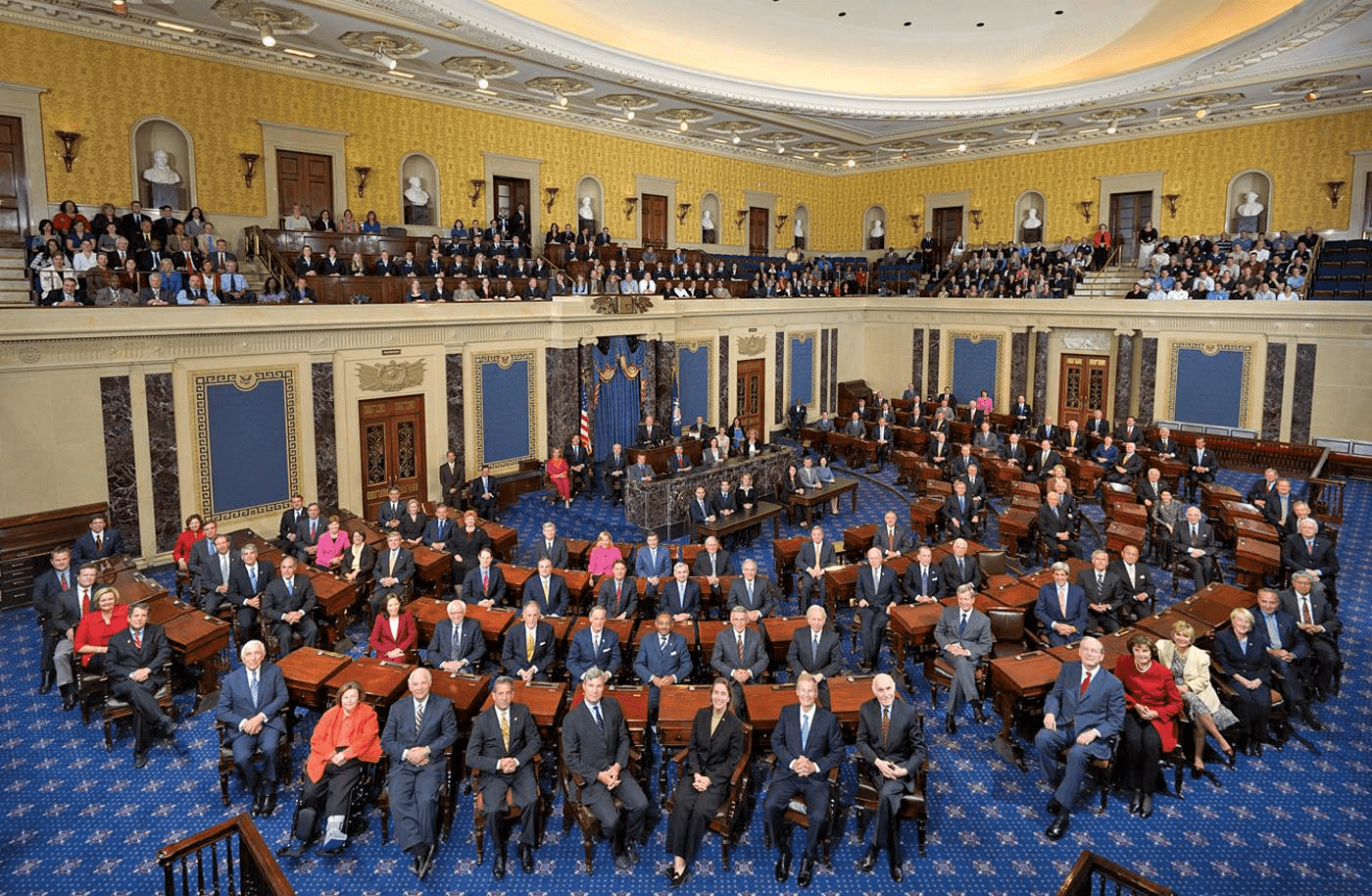

Давно действующая рабочая группа в Сенате опубликовала свою политическую рекомендацию по федеральному финансированию ИИ: 32 миллиарда долларов в год, охватывающее все: от инфраструктуры до серьезных задач и оценок рисков национальной безопасности.

Эта «дорожная карта» не является законопроектом или подробным политическим предложением, но, тем не менее, она дает представление о масштабах, на которые законодатели и «заинтересованные стороны» обращают внимание всякий раз, когда они доходят до реального дела – хотя вероятность того, что это произойдет в год выборов, невелика. исчезающе мал.

В заключительном отчете, опубликованном канцелярией сенатора Чака Шумера (демократ от Нью-Йорка), двухпартийная рабочая группа определяет наиболее важные области инвестиций, чтобы сохранить конкурентоспособность США по сравнению со своими соперниками за рубежом.

Вот несколько основных пунктов дорожной карты:

- «Межправительственные усилия по исследованиям и разработкам в области искусственного интеллекта, включая соответствующую инфраструктуру», означают, что Министерству энергетики, Национальному научному фонду, Национальному институту стандартов и технологий, НАСА, коммерции и полдюжины других агентств и департаментов форматировать и обмениваться данными в удобном для искусственного интеллекта формате. В каком-то смысле эта относительно простая задача является самой сложной из всех, и на ее решение, вероятно, потребуются годы.

- Финансируйте американское оборудование и программное обеспечение для искусственного интеллекта на уровне полупроводников и архитектуры, как посредством Закона о CHIPS, так и в других местах.

- Дальнейшее финансирование и расширение Национального исследовательского ресурса в области искусственного интеллекта, который все еще находится в зачаточном состоянии.

- «Грандиозные задачи ИИ» стимулировать инновации посредством конкуренции в «приложениях ИИ, которые коренным образом изменят процесс науки, техники или медицины, а также в фундаментальных темах безопасного и эффективного проектирования программного и аппаратного обеспечения».

- «Поддерживать готовность искусственного интеллекта и кибербезопасность» на выборах, в частности, чтобы «смягчить объективно ложный контент, созданный искусственным интеллектом, при этом защищая права Первой поправки». Наверное, сложнее, чем кажется!

- «Модернизировать федеральное правительство и улучшить предоставление государственных услуг» путем «обновления ИТ-инфраструктуры для использования современных технологий обработки данных и искусственного интеллекта, а также внедрения новых технологий для выявления неэффективности в кодексе США, федеральных правилах и программах закупок». Я понимаю, о чем здесь говорят, но для программы искусственного интеллекта это слишком много.

- Множество расплывчатых, но крупных вещей, связанных с обороной, таких как «оценка и смягчение химических, биологических, радиологических и ядерных (ХБРЯ) угроз, усиленных искусственным интеллектом, со стороны Министерства обороны, Министерства внутренней безопасности (DHS), Министерства энергетики и других соответствующих агентств».

- Обратите внимание на «регуляторный пробел» в сфере финансов и жилья, где процессы, основанные на искусственном интеллекте, могут использоваться для дальнейшей маргинализации уязвимых групп.

- «Проанализируйте, должны ли другие потенциальные варианты использования ИИ быть крайне ограничены или запрещены». После раздела о потенциально вредных вещах, таких как социальные оценки, управляемые ИИ.

- Законодательство, запрещающее созданные ИИ материалы о сексуальном насилии над детьми, а также другие изображения и средства массовой информации, полученные без согласия.

- Убедитесь, что у NIH, HHS и FDA есть инструменты, необходимые для оценки инструментов искусственного интеллекта в здравоохранении и медицинских приложениях.

- «Создать последовательный подход к общедоступным требованиям прозрачности для систем искусственного интеллекта», как частных, так и государственных.

- Повысить общую доступность «информации о происхождении контента», то есть данных обучения. Что использовалось для изготовления модели? Используете ли вы модель для ее дальнейшего обучения? И так далее. Производители ИИ будут бороться с этим изо всех сил до тех пор, пока не смогут в достаточной степени очистить добытые нечестным путем массивы данных, которые они использовали для создания сегодняшних ИИ.

- Посмотрите на риски и преимущества использования частного ИИ по сравнению с открытым исходным кодом (если последний когда-либо существует в форме, которая может масштабироваться).

Вы можете прочитать полный отчет здесь ; Есть еще много пунктов, из которых взято вышеприведенное (список более длинный, чем я ожидал). Никаких бюджетных цифр не предлагается.

Учитывая, что следующие шесть месяцев будут в основном посвящены ерунде, связанной с выборами, этот документ скорее служит ставке на множество общих идей, чем стимулированию действующего законодательства. Многое из того, что предлагается, потребует месяцев, если не лет, исследований и итераций, прежде чем будет принят закон или правило.

Индустрия искусственного интеллекта развивается быстрее, чем остальная часть технологического сектора, а это означает, что она опережает федеральное правительство на несколько порядков. Хотя перечисленные выше приоритеты в основном разумны, интересно, сколько из них сохранят свою актуальность к тому времени, когда Конгресс или Белый дом действительно примут меры.